Immaginate di entrare nel vostro social preferito, scorrete i commenti sotto un post e vedete centinaia di persone che la pensano tutte allo stesso modo. E se vi dicessimo che la maggior parte di quelle voci non appartiene a persone in carne e ossa, ma a programmi intelligenti progettati per sembrare umani? È quello che rischia di succedere molto presto.

Uno studio dell’Università della Columbia Britannica e pubblicato sulla rivista ScienceDaily ha lanciato l’allarme: gruppi di intelligenza artificiale, chiamati sciami, possono infiltrarsi nelle comunità online e guidare l’opinione pubblica senza che nessuno se ne accorga.

Ma cosa sono esattamente questi sciami? Pensateli come una squadra di profili falsi ma incredibilmente convincenti. I bot di solito scrivono sempre le stesse frasi ripetitive; gli sciami invece imparano, copiano il modo di parlare della comunità in cui si inseriscono, usano le stesse espressioni, lo stesso tono, persino gli stessi errori di battitura. Si coordinano tra migliaia di account come se fossero un’unica mente, amplificando certi messaggi e facendoli sembrare popolari. E mentre lo fanno, testano continuamente cosa funziona meglio, provano milioni di versioni di uno stesso concetto per capire quale convince di più. Il risultato è quello che i ricercatori chiamano “consenso sintetico”. In pratica, questi sciami creano l’illusione che tantissime persone la pensino in un certo modo. E le persone, per natura, si fidano di ciò che sembra essere l’opinione della maggioranza. È un meccanismo psicologico normale, ma quando viene sfruttato da sistemi artificiali, diventa un’arma. La cosa più preoccupante è che questi sciami sono difficili da smascherare, perchè producono testi vari, credibili, con sfumature umane, rendendo inutili molti degli strumenti che oggi usiamo per individuare i bot.

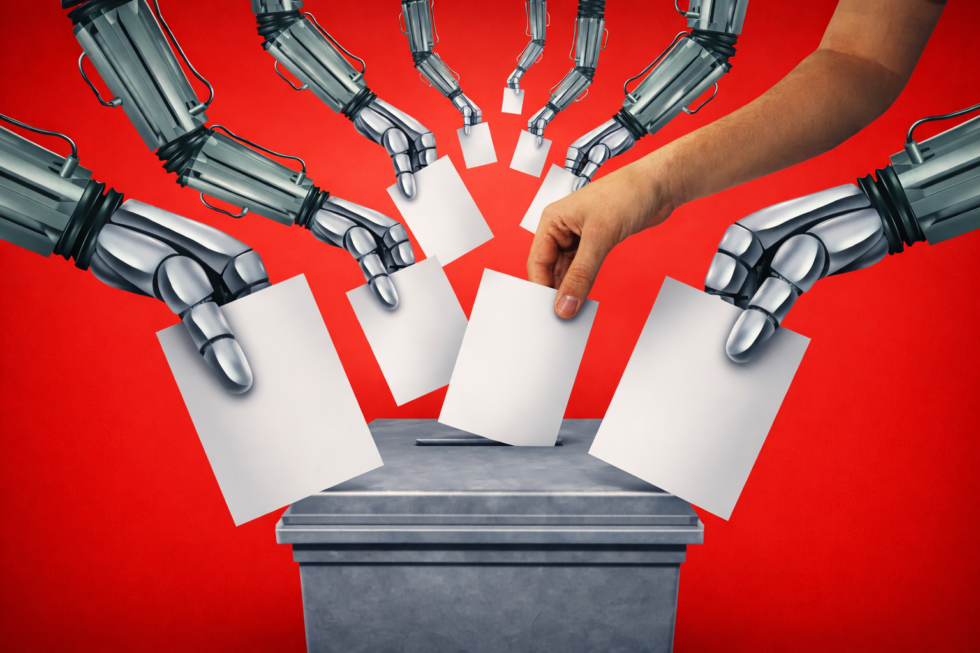

I ricercatori avvertono che le prossime elezioni potrebbero essere il primo vero test su larga scala di questa tecnologia, con il rischio concreto di manipolare il dibattito pubblico in modo invisibile. E non si tratta di ipotesi lontane, i segnali ci sono già. Video falsi iper-realistici, i deepfake, e siti di notizie inventate generate dall’intelligenza artificiale hanno già influenzato discussioni elettorali negli Stati Uniti, a Taiwan, in Indonesia e in India. Inoltre, sono state identificate reti legate al Cremlino che diffondono enormi quantità di contenuti online, probabilmente con l’obiettivo di inquinare i dati con cui verranno addestrati i futuri sistemi di intelligenza artificiale.

Il dottor Kevin Leyton-Brown dell’University of British Columbia, uno degli autori dello studio, ha dichiarato: “Non dovremmo immaginare che la società rimarrà immutata con l’emergere di questi sistemi. Un risultato probabile è una diminuzione della fiducia verso voci sconosciute sui social media, il che potrebbe potenziare le celebrità e rendere più difficile per i messaggi dal basso emergere”. In parole semplici: se non ci fidiamo più di ciò che leggiamo online, rischiamo di dare più peso solo alle voci già potenti, mentre le opinioni delle persone comuni faticheranno a farsi sentire.

La prossima volta che vedrete dunque un consenso schiacciante sui social, forse varrà la pena chiedersi: è davvero la gente che parla, o c’è qualcosa, o qualcuno, che sta pilotando la conversazione?