di Vincent Martin – Durante una telefonata con un amico che non sta bene, riusciamo sempre a capire il suo stato di salute. Ma quali indizi ha usato il nostro cervello per arrivare a una tale conclusione? Quello che dice la persona non è l’unico indizio che il nostro cervello usa per analizzare la condizione di salute dell’ interlocutore.

Malattie come la depressione, il Parkinson o l’ Alzheimer hanno un impatto sul funzionamento neurologico dei pazienti affetti e possono modificare il modo in cui parlano. Così, oltre al contenuto, il “contenitore” del discorso di un individuo, ovvero la voce, contiene informazioni sul suo stato di salute . Se la persona parla sospirando, articola meno, parla più lentamente o allunga le vocali, il nostro cervello analizzerà inconsapevolmente molti parametri vocali, che sono principalmente divisi in due categorie.

Da un lato, i parametri acustici che misurano la qualità della voce, come la frequenza, l’energia, la nasalità o l’ampiezza della voce.

Dall’altro, i parametri “prosodici” che misurano l’intonazione, il ritmo, la durata e l’accento del linguaggio. Questi indicatori della qualità del fraseggio consentono di spiegare il ritmo del discorso, la pronuncia e l’articolazione dell’oratore.

Tutte queste informazioni sono marcatori vocali che vengono utilizzati per stimare una grande quantità di informazioni sul nostro interlocutore, in modo indiretto parliamo di “inferenza”.

Oggi, gli algoritmi di intelligenza artificiale possono, calcolando e interpretando i marker vocali sopra descritti, identificare un intero pannello di patologie che colpiscono la persona, la cui voce abbiamo registrato.

Questi sistemi di intelligenza artificiale hanno tutti in comune il fatto di essere basati sull’apprendimento supervisionato: questi sistemi richiedono un database annotato manualmente da specialisti, dal quale regolano i relativi dati di ciascun segnale vocale.

Da tempo si studiano applicativi che tentano di stimare la gravità dei sintomi, la maggior parte dei sistemi attuali mira a classificare i campioni in categorie, generalmente “soggetto malato” o ” soggetto sano”.

L’approccio più vecchio, ma ancora il più utilizzato, consiste nell’estrarre i marker in modo automatico, ma esplicito (ad esempio la media della frequenza della voce), quindi addestrare su di essi un “classificatore” . I marcatori utilizzati dal sistema sono quindi perfettamente noti ed è possibile identificare i meccanismi vocali che consentono la rilevazione della malattia.

Approcci più nuovi e innovativi utilizzano l’apprendimento profondo (deep learning), che consente di ottenere buone prestazioni di classificazione tra soggetti sani e pazienti malati. È il caso, ad esempio, del sistema più avanzato per la rilevazione della depressione, che raggiunge un punteggio di classificazione del 74,0% . Per estrarre e classificare i marker vocali, questo sistema studia anche il contenuto in frequenza dei campioni audio, ma utilizza “strati neurali convoluzionali” per farlo. Se questo metodo dà ottimi risultati, il suo principale svantaggio risiede nella mancanza di interpretabilità dei parametri estratti: quali segnali vocali ha ascoltato il sistema per indovinare se la persona è depressa?

L’utilizzo di tali sistemi per rilevare i segni di patologie nella voce presenta due sfide principali.

Prima di tutto, una prima diagnosi possibile di malattie neurodegenerative. Per queste malattie, ad esempio Alzeihmer o Parkinson, il ritardo nella diagnosi complica la gestione dei pazienti. La voce, perché alterata con la malattia, per la sua facilità di acquisizione e per il suo basso costo (basta un microfono per registrare i pazienti), è un marker molto promettente. Ad esempio, nel 2011 un team dell’Università di Praga ha studiato la voce dei pazienti con una forma precoce di Parkinson ed è riuscito a ottenere un punteggio dell’85,02% di classificazione corretta grazie a diversi marker vocali: il “rapporto rumore/armoniche”, che misura la “purezza” della voce, il numero di cadute di intensità al secondo, un marker che quantifica l’accuratezza dell’articolazione e infine il tipo della frequenza fondamentale della voce. Pertanto, rispetto alle loro controparti sane, i pazienti con malattia di Parkinson in questo studio avevano una voce meno nitida e più rumorosa, che spesso diminuiva di intensità, con articolazione ridotta e una frequenza che variava di meno.

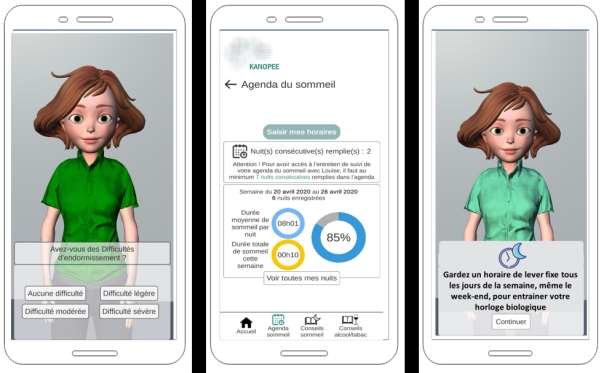

Un’altra applicazione promettente è quella dei medici virtuali. Questi assistenti, che si sono dimostrati particolarmente efficaci nel monitoraggio del sonno e dell’affaticamento con l’app Kanopée, consentono di offrire una consulenza personalizzata all’utente, sulla base delle informazioni che quest’ultimo compila regolarmente. Una collaborazione tra un team del laboratorio di ricerca informatica di Bordeaux e il laboratorio SANPSY dell’Ospedale universitario di Bordeaux sta così lavorando per integrare un’intelligenza artificiale per analizzare la voce e stimare la sonnolenza degli utenti. Questo approccio consente di monitorare i disturbi del sonno dell’utente nel suo ambiente di vita abituale, inaccessibile al medico, e di misurare l’efficacia dei consigli forniti dall’applicazione.

Questa collaborazione ha già portato allo sviluppo di un sistema di rilevamento della sonnolenza. Le persone assonnate tendono ad allungare le vocali, con una frequenza ed energia che varia di meno, con “formanti” distorte e una voce meno limpida.

Perché questi sistemi non sono ancora utilizzati nella pratica clinica?

Differenze linguistiche nei database, differenze nelle misurazioni della patologia o persino differenze nella popolazione, ci sono molti ostacoli all’unificazione dei risultati ottenuti da ogni team di ricerca. Inoltre, pochissimi studi hanno esaminato i casi di diverse patologie simultanee. Ad esempio, una persona depressa può anche essere dislessica o avere il raffreddore. In questo caso, entrambe le malattie sono espresse nella voce e le conoscenze attuali non sono sufficienti per specificarle esclusivamente. Sono quindi necessari studi complementari per completare i modelli e portare a poco a poco un sistema “universale”. Inoltre, l’affidabilità dei sistemi deve essere tanto maggiore in quanto una cattiva diagnosi di un’Intelligenza Artificiale potrebbe avere importanti conseguenze sulla gestione di un paziente. Anche se alcune malattie sono rilevate in modo credibile dalle IA, l’affidabilità di questi sistemi deve essere verificata e ricontrollata più volte. Come ci ricorda il fisico e filosofo della scienza Étienne Klein: “la ricerca è un processo che richiede tempo”.

Un altro ostacolo ai prossimi progressi nel campo dell’IA vocale potrebbe ovviamente essere etico: la questione del rispetto per la privacy degli utenti dei dispositivi collegati che utilizzano la voce. Se la stima dello stato di salute di una persona grazie alla sua voce consente una migliore assistenza medica, cosa pensare dello stesso utilizzo da parte di aziende private, valutando o commercializzando le stesse informazioni, potenzialmente all’insaputa dei propri utenti?

Ricerca di Vincent Martin pubblicata su The Conversation