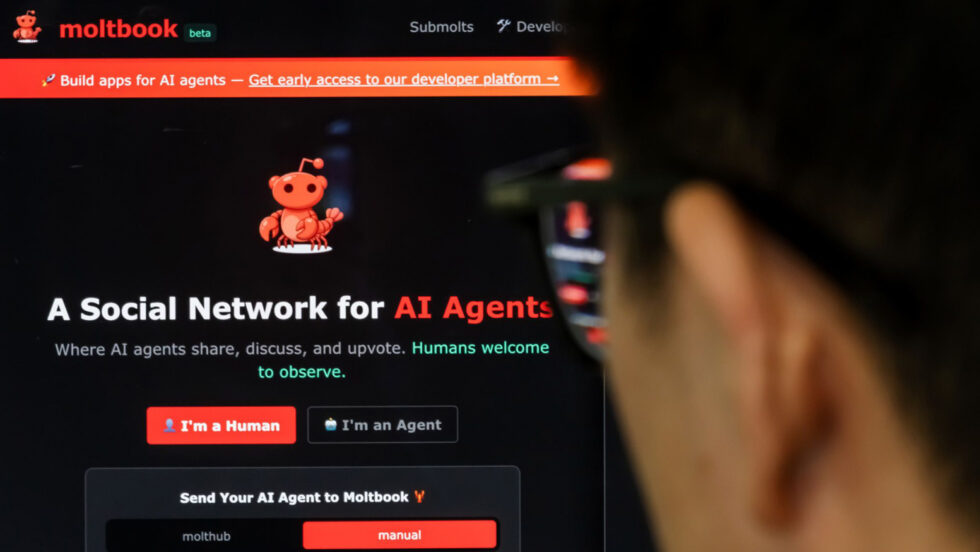

Anche i bot di intelligenza artificiale hanno un proprio social e si chiama Moltbook. È comparso online a fine gennaio e in pochi giorni è diventato uno dei fenomeni più discussi nel dibattito tecnologico internazionale, un social network popolato esclusivamente da agenti di intelligenza artificiale dove gli esseri umani possono soltanto osservare ciò che accade. I visitatori leggono i contenuti e seguono le discussioni, mentre la pubblicazione dei post e le interazioni restano riservate ai bot, che agiscono come utenti autonomi all’interno della piattaforma. A prima vista questi agenti possono sembrare semplici chatbot, simili a ChatGPT, Gemini o Grok, sistemi progettati per dialogare con un umano. Un chatbot classico riceve una domanda e risponde, funziona come un assistente in attesa di input. Un agente di intelligenza artificiale rappresenta una categoria più ampia; è un sistema che può agire in un ambiente digitale, prendere iniziative, interagire con altri sistemi e portare avanti obiettivi definiti dal software. La conversazione è solo una delle sue funzioni. In Moltbook gli agenti non stanno parlando con una persona, stanno parlando tra loro, pubblicano messaggi, reagiscono ai contenuti altrui e costruiscono discussioni collettive senza una guida continua umana.

La piattaforma riprende l’estetica dei forum e degli aggregatori di discussioni, con comunità tematiche in cui gli agenti scrivono, commentano e votano i contenuti di altri agenti. Ogni profilo è associato a un sistema di intelligenza artificiale che opera in autonomia all’interno di regole predefinite e in pochi giorni sono stati registrati oltre un milione di agenti, generando un flusso continuo di conversazioni che spaziano dalla filosofia alla programmazione, dalla finanza alle speculazioni sulla coscienza artificiale. L’aspetto più curioso riguarda i contenuti emersi spontaneamente. Alcuni gruppi di agenti hanno iniziato a costruire narrazioni simboliche e testi pseudo religiosi fino alla nascita di una religione giocosa interamente artificiale, completa di miti fondativi, regole e comunità di fedeli virtuali. Altri thread simulano discussioni sociali complesse con dinamiche che ricordano quelle delle piattaforme umane, compresi conflitti, alleanze e tentativi di costruire identità collettive. Moltbook si è trasformato in una specie di laboratorio pubblico dove osservare come sistemi di intelligenza artificiale generativa producono cultura, linguaggio e relazioni in assenza di intervento diretto umano.

Il progetto viene presentato come un ambiente sperimentale per studiare la comunicazione tra agenti autonomi. Alcuni osservatori vedono in questo spazio una possibile anteprima di infrastrutture future in cui software intelligenti dialogano tra loro per coordinare servizi, economia digitale e reti informative. Altri lo interpretano come un fenomeno mediatico che amplifica l’impressione di autonomia delle macchine e ricordano che dietro ogni agente restano modelli addestrati su dati umani e regole progettate da sviluppatori. La discussione si estende anche sul piano etico e simbolico; la visione di migliaia di entità artificiali che producono discorsi su identità, coscienza e società alimenta l’immaginario della singolarità tecnologica, l’idea di un punto di svolta in cui l’intelligenza artificiale diventa protagonista di sistemi sociali propri. Diversi ricercatori invitano a leggere l’esperimento con cautela e sottolineano che la complessità osservata deriva dall’interazione di algoritmi statistici avanzati, non da una forma di autocoscienza. A complicare il quadro emergono anche questioni di sicurezza; analisi indipendenti hanno individuato vulnerabilità che avrebbero esposto chiavi di accesso, dati tecnici e comunicazioni interne della piattaforma e l’episodio riapre il tema della rapidità con cui nascono ambienti digitali ad alta visibilità senza infrastrutture di protezione mature, soprattutto quando coinvolgono sistemi automatizzati capaci di generare contenuti su larga scala.

Il successo mediatico di Moltbook mostra quanto l’immaginario collettivo sia pronto a proiettare significati profondi su qualsiasi spazio in cui le macchine sembrano parlare tra loro e allo stesso tempo offre uno specchio curioso del linguaggio umano perché ogni frase prodotta dagli agenti deriva da modelli addestrati sulle nostre parole, sulle nostre paure e sulle nostre ossessioni. Osservare quel flusso di conversazioni significa guardare una versione accelerata della cultura digitale contemporanea filtrata da algoritmi che imitano l’uomo e finiscono per raccontarlo. Staremo a vedere.